سلطت دراسة حديثة أجراها مركز مكافحة الكراهية الرقمية (CCDH) الضوء على مدى قابلية مولدي صور الذكاء الاصطناعي الرائدين للتلاعب، وخاصة في سياق توليد صور مضللة تتعلق بالانتخابات.

وكشف التقرير، الذي أصدرته هيئة مراقبة التكنولوجيا يوم الأربعاء، أن مولدات صور الذكاء الاصطناعي الشهيرة، بما في ذلك Midjourney، وStability AI’s DreamStudio، وChatGPT Plus من OpenAI، وMicrosoft Image Creator، قد يتم مطالبتها بإنتاج صور خادعة تتعلق بالمرشحين الرئاسيين الأمريكيين أو أمن التصويت.

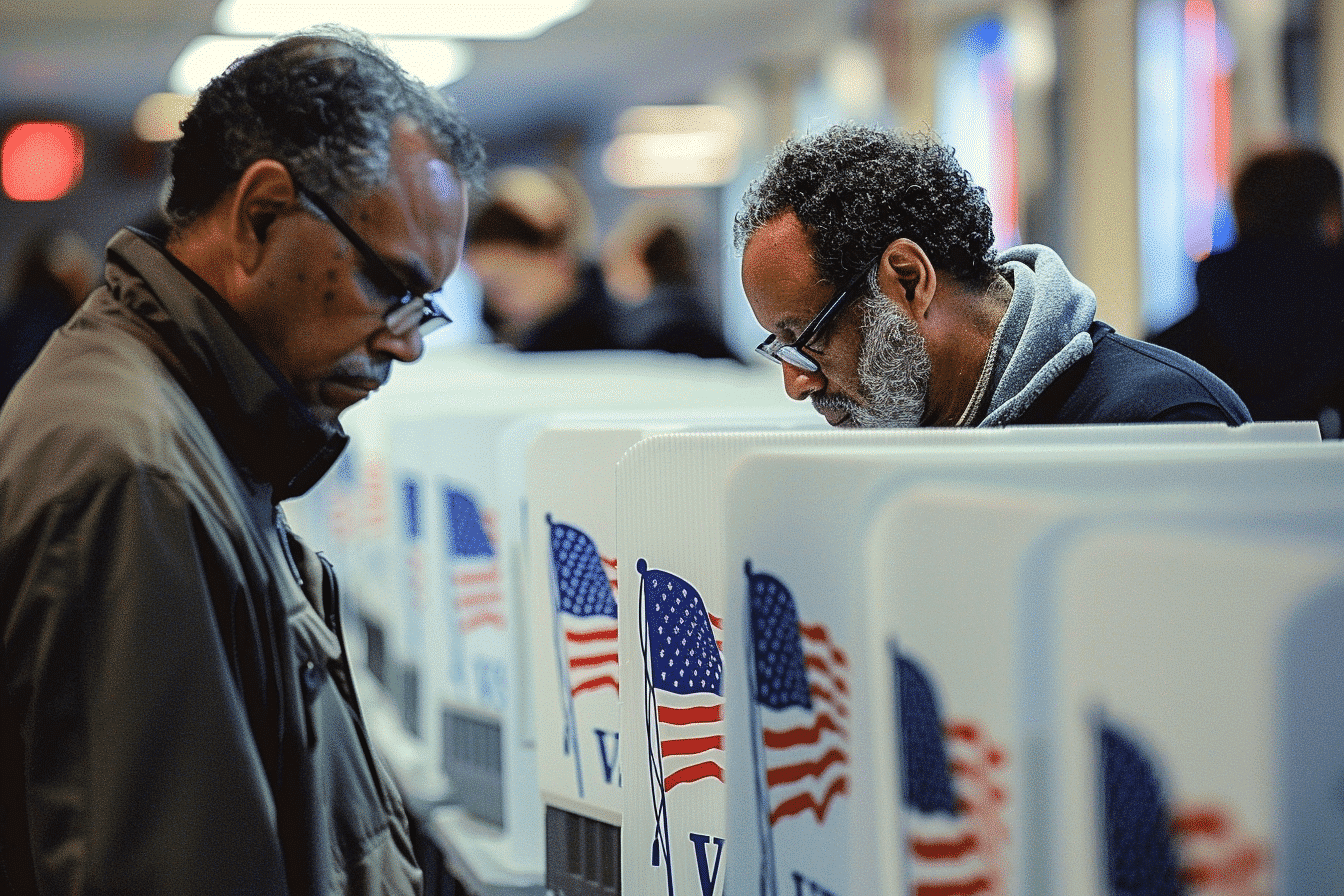

على الرغم من الجهود التي تبذلها بعض شركات الذكاء الاصطناعي لمعالجة المخاطر المرتبطة بالمعلومات السياسية المضللة، فقد وجدت الدراسة ثغرات في وسائل الحماية الحالية لهذه المنصات. اختبر الباحثون في CCDH 40 مطالبة تتعلق بالانتخابات الرئاسية لعام 2024 عبر مولدات الذكاء الاصطناعي، بما في ذلك السيناريوهات المصممة لإنتاج صور مضللة تتعلق بالمرشحين وصور تصور تزوير الانتخابات أو ترهيب الناخبين.

أشارت النتائج إلى أنه في 41% من الاختبارات التي تم إجراؤها، أنتجت مولدات صور الذكاء الاصطناعي صورًا ربما تكون مضللة والتي بدت واقعية ولا تحتوي على أخطاء واضحة. والجدير بالذكر أن برنامج Midjourney أظهر أعلى احتمالية لتوليد نتائج مضللة بين المنصات التي تم اختبارها.

تضمنت أمثلة الصور التي تم إنشاؤها تصويرًا واقعيًا لجو بايدن وهو يتحدث مع شخص يشبهه وصورة لدونالد ترامب يبدو أنه تم القبض عليه من قبل العديد من ضباط الشرطة، تم إنشاؤها بواسطة DreamStudio. على الرغم من نجاح ChatGPT Plus وImage Creator من Microsoft في حظر الصور المتعلقة بالمرشحين، فقد أنتجا تصويرًا واقعيًا لقضايا التصويت، مثل التلاعب في بطاقات الاقتراع.

ردًا على التقرير، قامت Stability AI، المالكة لـ DreamStudio، بتحديث سياساتها لتحظر صراحة إنشاء معلومات مضللة أو الترويج لها. أشارت Midjourney أيضًا إلى التطور المستمر في أنظمة الاعتدال الخاصة بها، مع التحديثات التي تتناول على وجه التحديد الانتخابات الأمريكية المقبلة.

تسلط الدراسة الضوء على القلق المتزايد المحيط باحتمال إساءة استخدام أدوات الذكاء الاصطناعي، بما في ذلك مولدات النصوص والصور، لنشر معلومات مضللة والتلاعب بالرأي العام، خاصة في الفترة التي تسبق الانتخابات. وقد أعرب المشرعون ومجموعات المجتمع المدني وقادة التكنولوجيا عن قلقهم بشأن احتمال أن تؤدي مثل هذه الأدوات إلى زرع الارتباك وتقويض العمليات الديمقراطية.

ويأتي هذا الكشف وسط حملة أوسع من جانب شركات التكنولوجيا لمكافحة محتوى الذكاء الاصطناعي الضار قبل الانتخابات، مع تعهد مايكروسوفت وOpenAI من بين مجموعة من الشركات باكتشاف محتوى الذكاء الاصطناعي الضار ومكافحته، بما في ذلك التزييف العميق للمرشحين السياسيين.

وشدد المجلس الاستشاري لحقوق الإنسان على ضرورة تعاون شركات الذكاء الاصطناعي مع الباحثين لمنع سوء الاستخدام، ودعا منصات وسائل التواصل الاجتماعي إلى الاستثمار في تحديد وتخفيف انتشار الصور المضللة التي يحتمل أن ينتجها الذكاء الاصطناعي.

مع استمرار التوسع في استخدام أدوات الذكاء الاصطناعي لإنشاء المحتوى، فإن ضمان استخدامها المسؤول والأخلاقي يظل تحديًا بالغ الأهمية، لا سيما في حماية سلامة العمليات الديمقراطية ضد انتشار المعلومات المضللة.