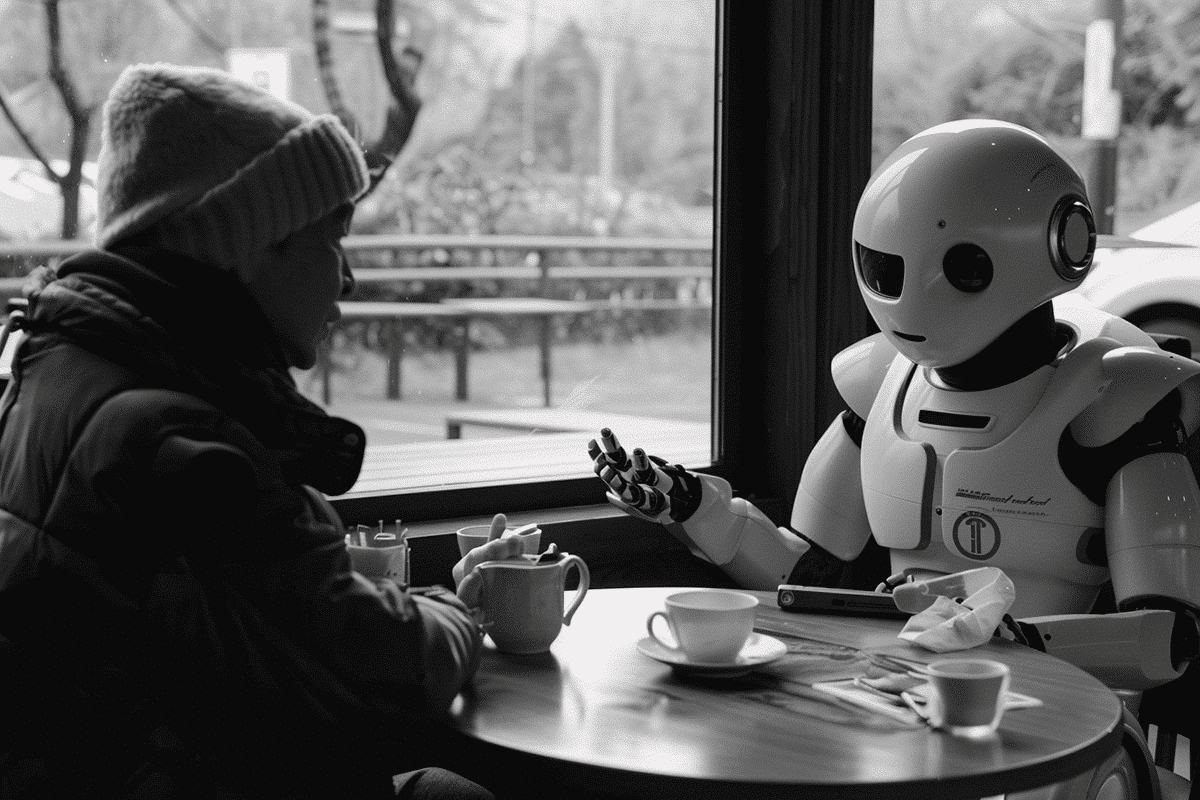

في تطور رائد يردد أصداء الأسئلة التي طرحها الفيلسوف الفرنسي رينيه ديكارت، والتي أعاد تشكيلها فيما بعد عالم الرياضيات آلان تورينج، قرّبنا باحثون في جامعة كاليفورنيا في سان دييغو من الإجابة عما إذا كان بإمكان الآلات محاكاة السلوك البشري بشكل مقنع. تشير دراسة حديثة إلى أنه في تجربة خاضعة للرقابة، لم يتمكن المشاركون من تمييز نظام الذكاء الاصطناعي المتقدم ChatGPT-4 عن الإنسان بعد محادثة مدتها خمس دقائق فقط.

يسعى اختبار تورينج، الذي اقترحه تورينج عام 1950، إلى تحديد قدرة الآلة على إظهار سلوك ذكي لا يمكن تمييزه عن سلوك الإنسان. وبدلاً من مجرد السؤال عما إذا كانت الآلات قادرة على التفكير، يركز اختبار تورينج على قدرتها على محاكاة الاستجابات البشرية. بعد عقود من التقدم في مجال الذكاء الاصطناعي، كشفت دراسة حديثة أن الذكاء الاصطناعي قد تقدم الآن إلى درجة أن قدراته في المحادثة يمكن أن تخدع الشخص العادي ليظن أنه يتحدث إلى إنسان.

شملت الدراسة العديد من أنظمة الذكاء الاصطناعي والمشاركين من البشر. شارك البشر في محادثات قصيرة مع إنسان أو ذكاء اصطناعي ثم طُلب منهم تحديد المحاور على أنه إنسان أو آلة. كشفت النتائج أن المشاركين خمنوا بشكل صحيح حوالي 50% فقط من الوقت عند التفاعل مع ChatGPT-4، مما يشير إلى تقدم كبير في قدرة الذكاء الاصطناعي على محاكاة أنماط المحادثة البشرية.

وعلى الرغم من هذه النتائج، فقد أثار هذا الإنجاز جدلاً حول ما يعنيه حقًا أن يجتاز الذكاء الاصطناعي اختبار تورينج. يجادل منتقدو الاختبار بأن إقناع الإنسان أثناء المحادثة لا يعني بالضرورة امتلاك ذكاء شبيه بذكاء الإنسان. يميل البشر إلى التجسيم، حيث ينسبون الخصائص البشرية للأشياء والأنظمة، مما قد يؤدي إلى تحريف تصورات سلوك الذكاء الاصطناعي.

لإنشاء خط أساس للتجربة، قام الباحثون بتضمين برنامج ELIZA، وهو برنامج ذكاء اصطناعي تم تطويره في الستينيات من القرن الماضي ومعروف بقدراته الأساسية في المحادثة. لم تتمكن ELIZA من إقناع 22% فقط من المشاركين باستجاباتها الشبيهة باستجابات البشر، وهو ما يتناقض بشكل صارخ مع أداء أنظمة الذكاء الاصطناعي الحديثة مثل ChatGPT، التي تتميز بقدرات برمجة وتعلم أكثر تطوراً. يؤكد هذا الاختلاف الصارخ على التقدم التكنولوجي الذي حدث على مدار عقود في مجال الذكاء الاصطناعي.

يثير هذا الاختراق أسئلة مهمة حول الدور المستقبلي للذكاء الاصطناعي في المجتمع. مع ازدياد مهارة أنظمة الذكاء الاصطناعي في محاكاة السلوك البشري، يمكن استخدامها بشكل متزايد في الأدوار التي تواجه العملاء، مما قد يحل محل الوظائف البشرية في بعض القطاعات. وعلاوة على ذلك، فإن قدرة الذكاء الاصطناعي على خداع البشر تفتح مجالات لإساءة الاستخدام في مجالات مثل الاحتيال والتضليل، حيث يصبح التمييز بين الإنسان والآلة أمرًا بالغ الأهمية.

وعلاوة على ذلك، لاحظ الباحثون أن المشاركين في التجربة ركزوا بشكل أقل على العلامات التقليدية للذكاء، مثل المعرفة والمنطق، وأكثر على الأسلوب اللغوي والإشارات الاجتماعية والعاطفية. تشير هذه الملاحظة إلى أن الذكاء الاجتماعي قد يصبح معيارًا جديدًا لقياس قدرات الذكاء الاصطناعي في التفاعلات الشبيهة بالبشر.

مع استمرار تطور الذكاء الاصطناعي، تزداد أهمية الآثار المترتبة على اندماجه في الحياة اليومية. وفي حين أن هذه التكنولوجيا تقدم العديد من الفوائد، بما في ذلك أتمتة المهام العادية وتحليل مجموعات كبيرة من البيانات، إلا أن قدرتها على محاكاة البشر عن كثب تستدعي النظر بعناية في المبادئ التوجيهية واللوائح الأخلاقية.

تمثل الدراسة التي أجرتها جامعة كاليفورنيا في سان دييغو علامة فارقة في أبحاث الذكاء الاصطناعي. وهو لا يسلط الضوء على قدرات تقنيات الذكاء الاصطناعي الحالية فحسب، بل يحث أيضاً على إجراء تقييم نقدي لما يعنيه الذكاء في عصر الآلات. ومع تزايد عدم إمكانية تمييز الذكاء الاصطناعي عن البشر في سياقات معينة، يستمر التمييز بين الذكاء البشري والذكاء الاصطناعي في التلاشي، مما يمهد الطريق لمستقبل قد يصبح فيه الذكاء الاصطناعي جزءًا لا يتجزأ من النسيج الاجتماعي.